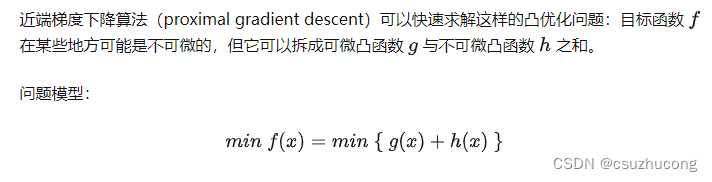

近端梯度下降

前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家:点击跳转

目录

1,求解目标

g 是凸函数,可微。

ℎ 是凸函数,未必可微。

我的理解:不是所有f都适用这个方法,h实际上只能取一些常见的简单的函数。

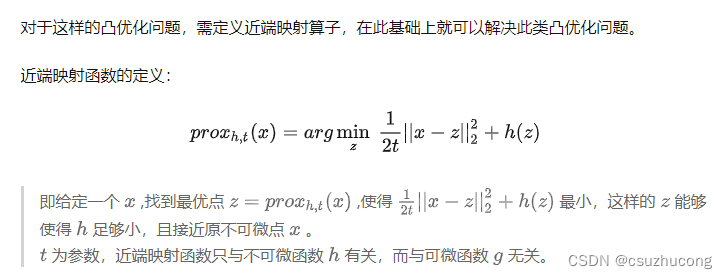

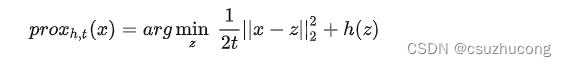

2,近端映射

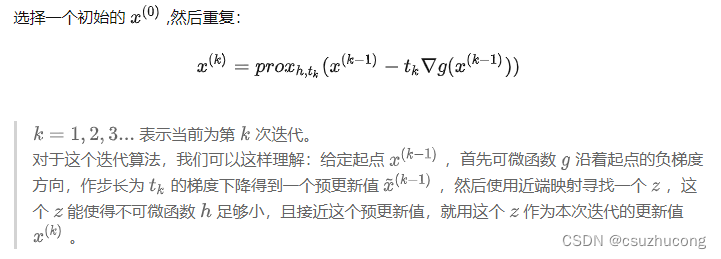

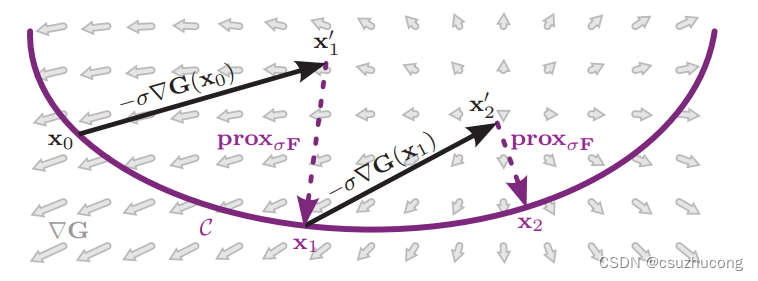

3,近端梯度下降

4,实例

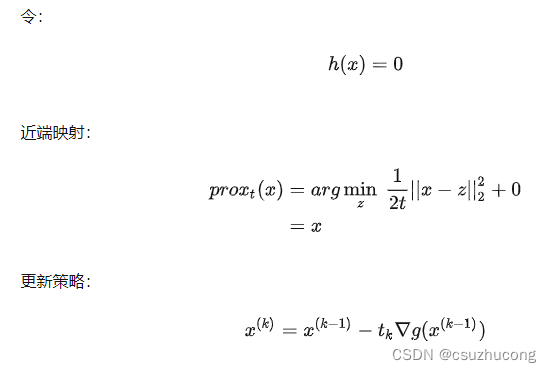

(1)常规梯度下降

结果就是常规梯度下降。

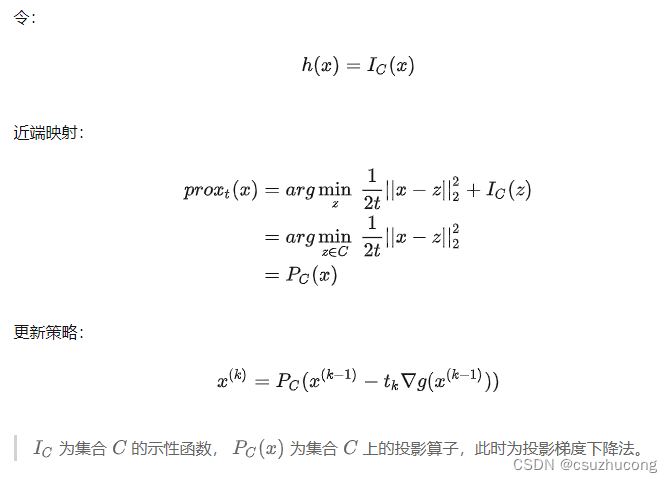

(2)投影梯度下降

5,近端映射函数性质

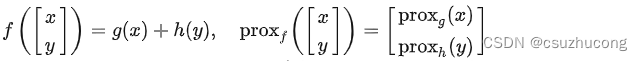

(1)分量组合

性质一:

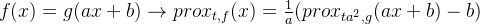

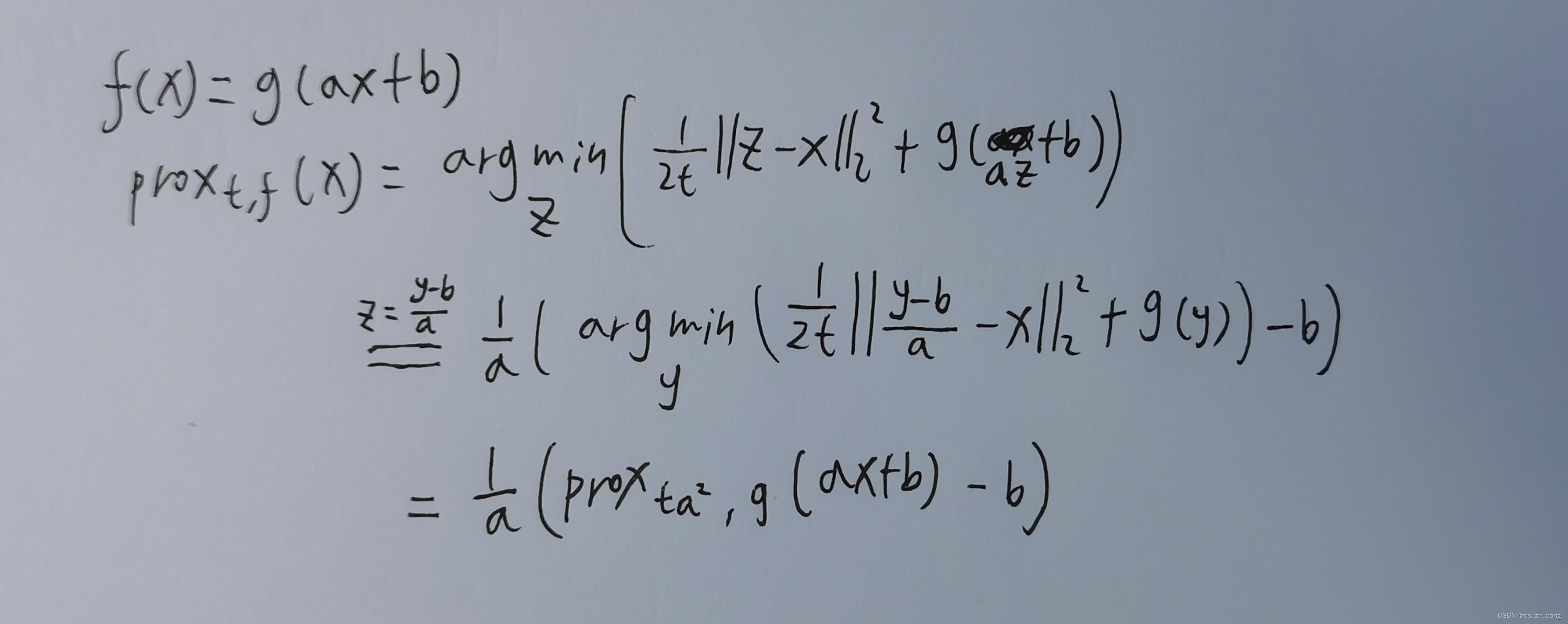

(2)线性变换

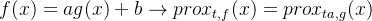

性质二:

性质三:

PS:这里的a是标量

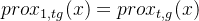

(3)t变换

根据性质三,取b=0可得性质四:

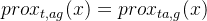

(4)四则运算

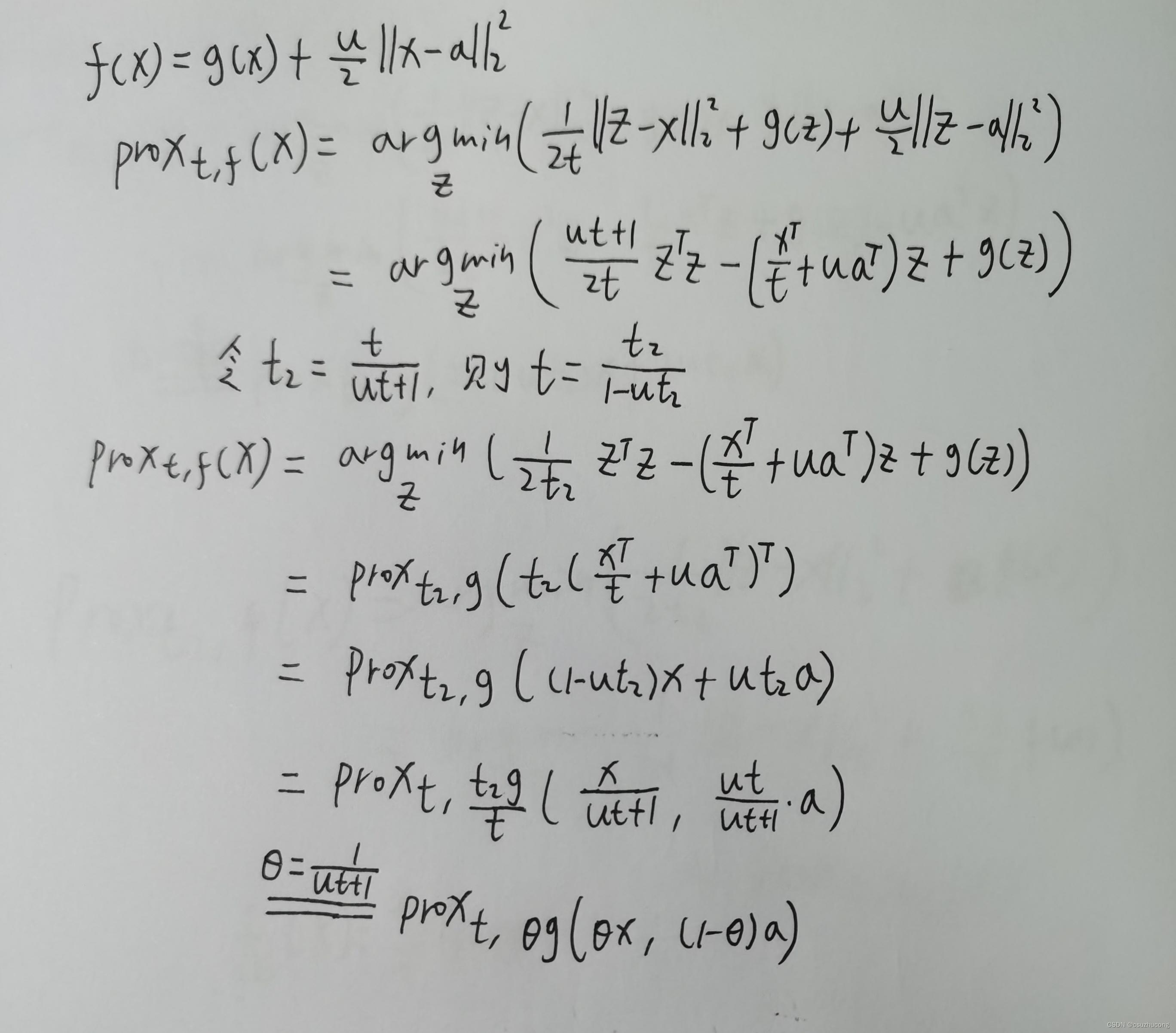

性质五:

例如,g(x)=x^2,f(x)=g(x)+x,a=1,t=2

那么,prox g (x) = x/5, prox f (x) = (x-2)/5

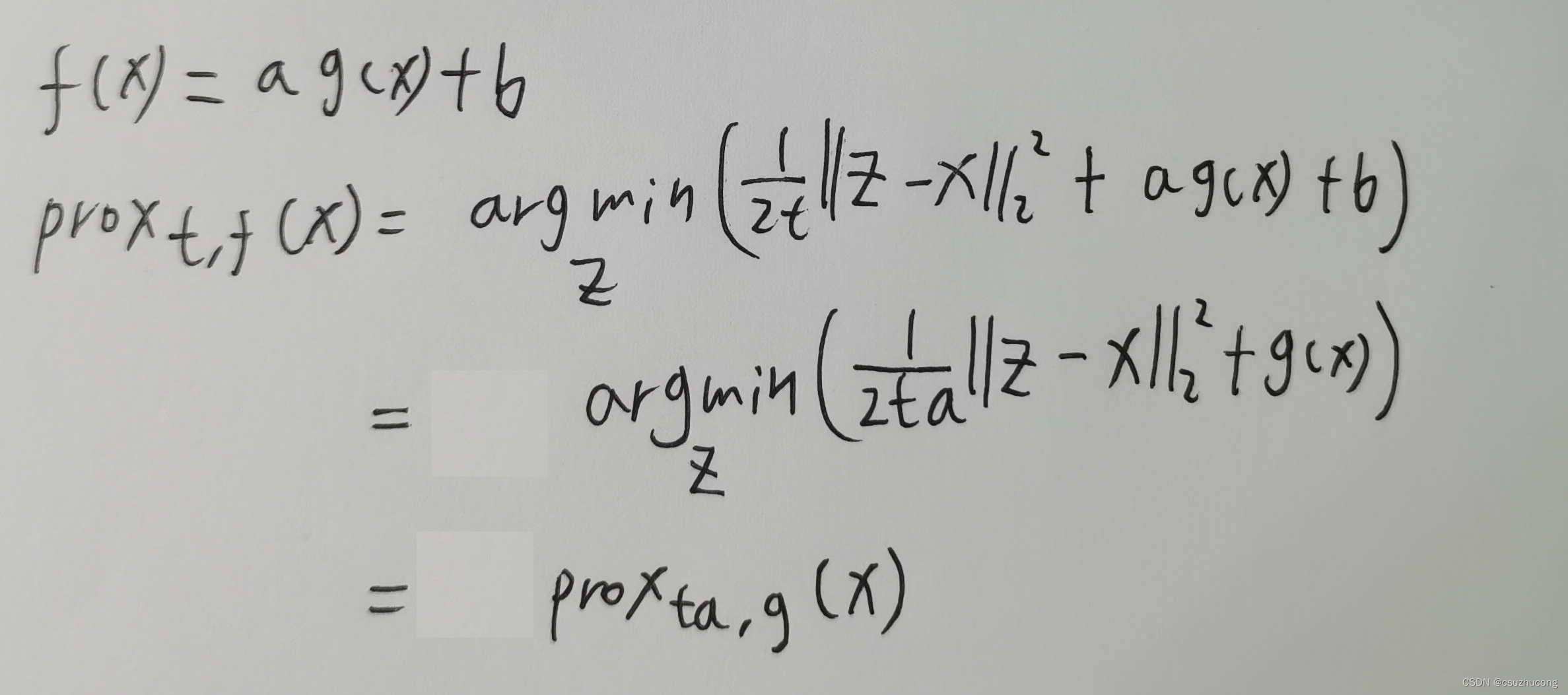

性质六:

PS:这里的a是向量

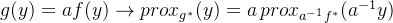

(5)共轭函数的近端映射函数

推导:

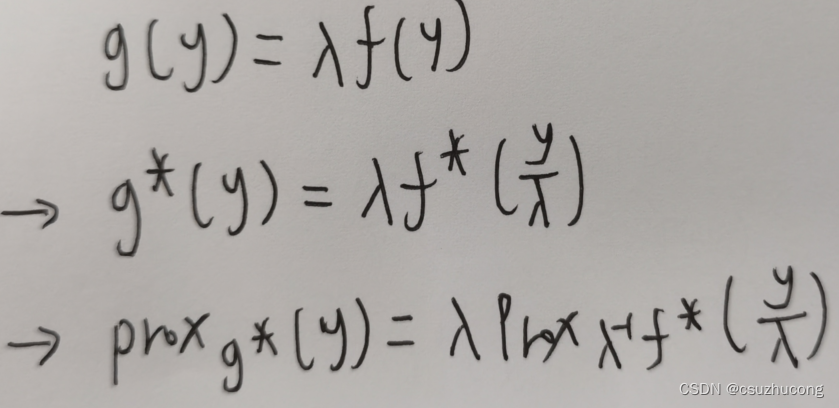

(6)省略写法说明

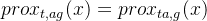

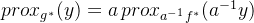

省略方式一

由于t变换的优美:

很多时候 就简写成

就简写成

如:

其实是

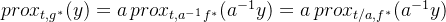

省略方式二

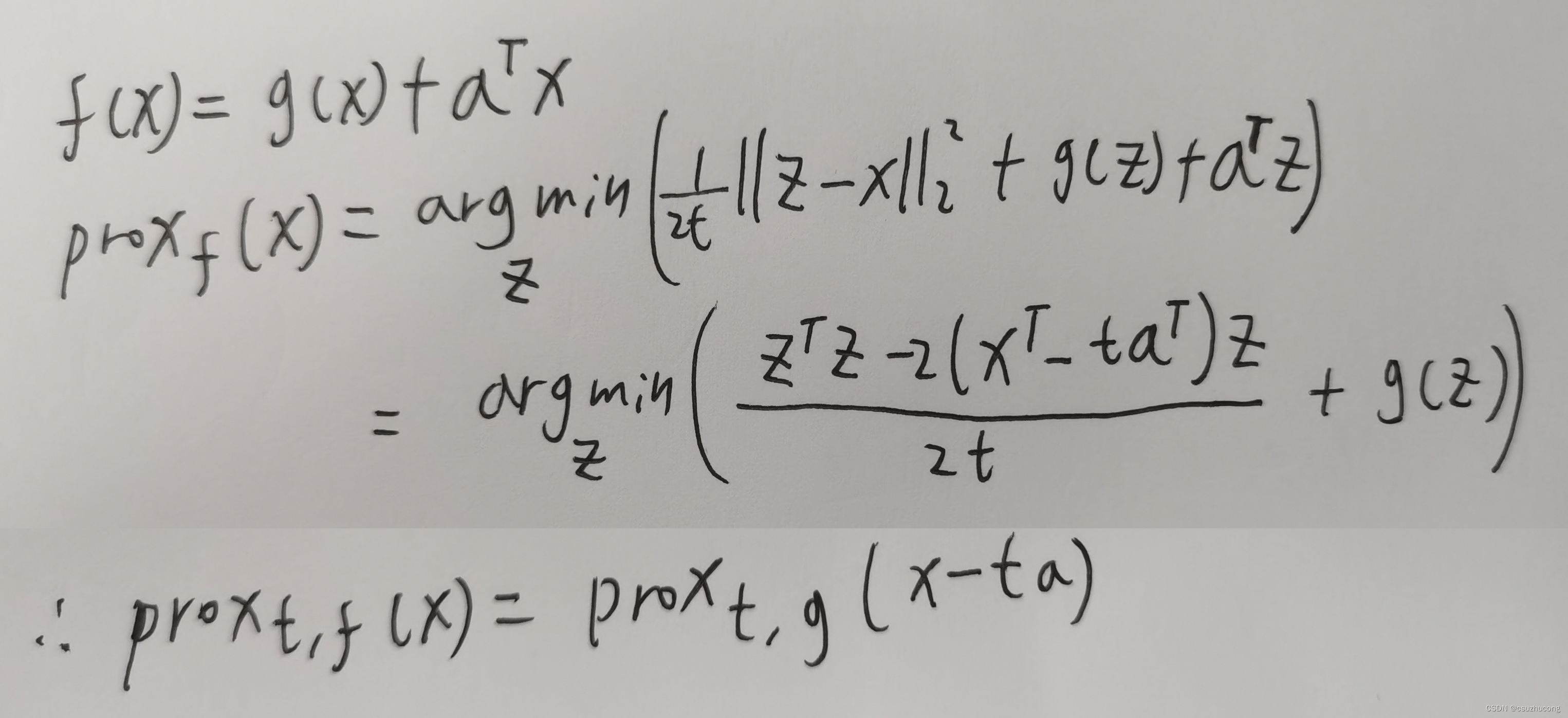

而有时我们又用 表示

表示

这是2种截然不同的省略约定,在这个基础上去理解公式就没啥问题了。

6,近端映射函数计算实例

上面2个例子给出了2个很特殊的函数的近端映射函数,这里展开讲讲更多的例子。

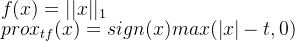

(1)L1范数

`sign`函数是一个数学和计算机科学中常用的函数,用于确定数字的符号。具体来说,如果数字大于0,则`sign`函数返回1;如果数字等于0,则返回0;如果数字小于0,则返回-1。

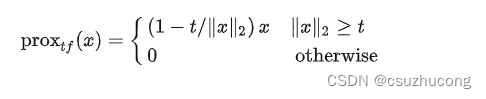

(2)L2范数

![]()

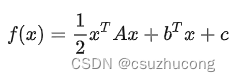

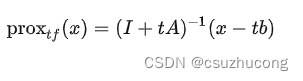

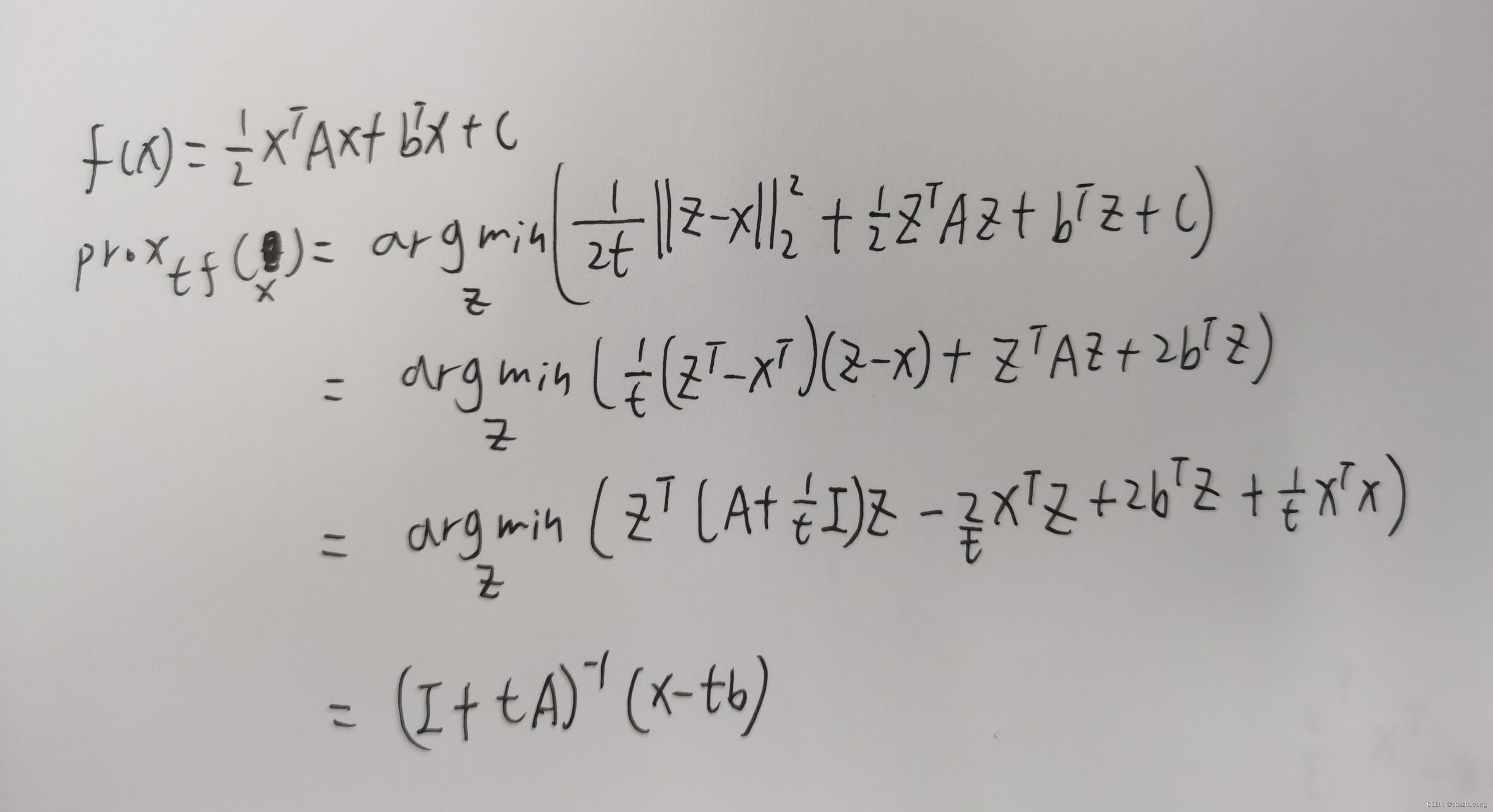

(3) 二次函数

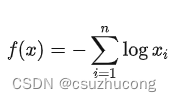

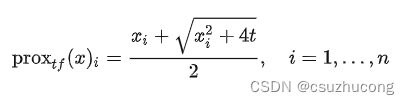

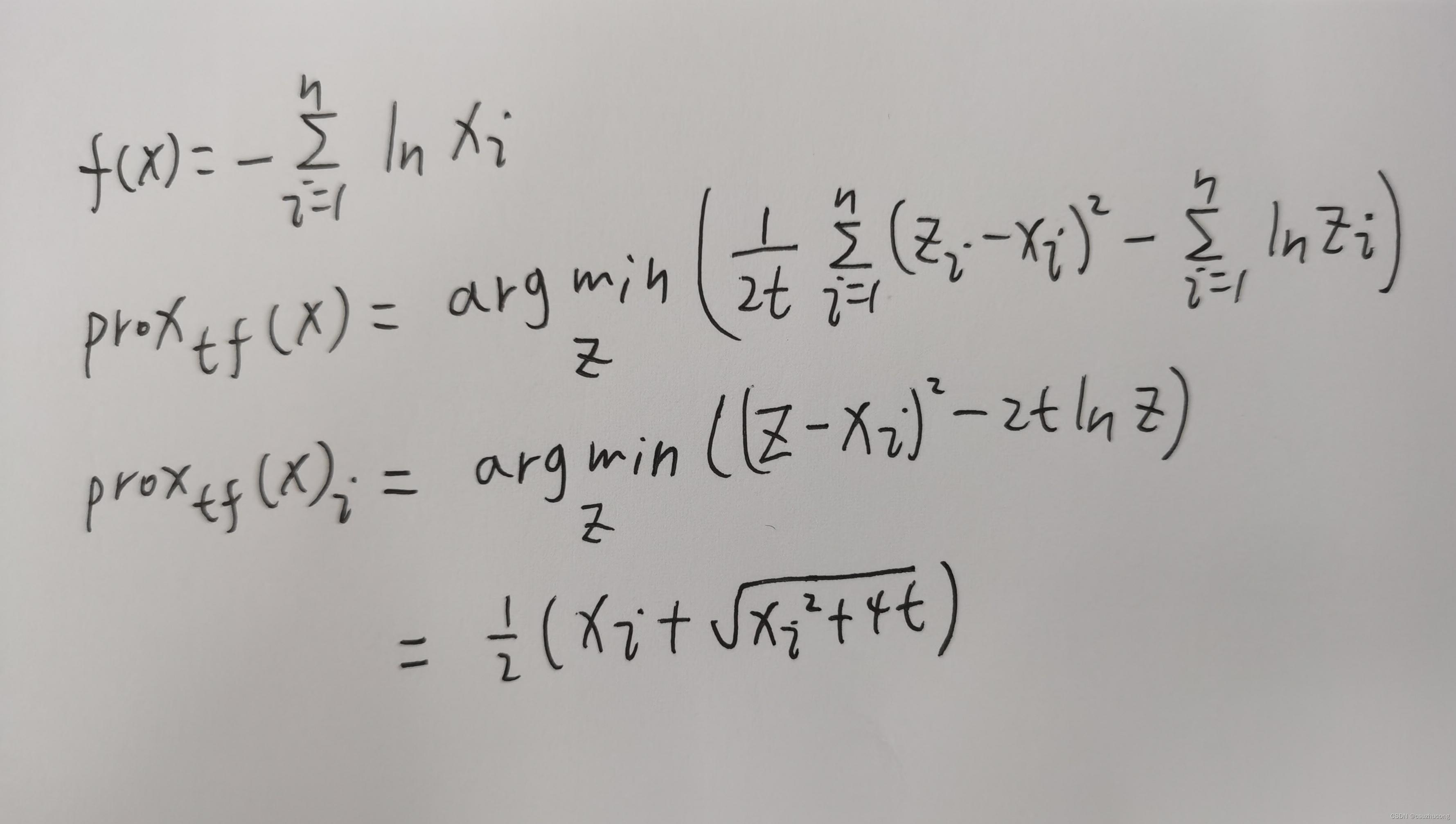

(4)分量对数求和函数